近年來,基於大型語言模型(LLM)的自主代理在架構、記憶、感知、推理與行動等方面不斷發展,在多個領域展現出重新定義可能性的潛力。

譯文:AI Agents : Research & Applications(Accelxr)

作者: Rituals

編譯:白話區塊鏈

封面: Photo by Trophim Lapteff on Unsplash

近年來,代理(Agent)的概念在哲學、遊戲和人工智慧等多個領域的重要性日益凸顯。從傳統意義上看,代理指的是一個實體能夠自主行動、做出選擇並且具有意圖性,這些特質通常與人類連結在一起。

而在人工智慧領域,代理的內涵變得更加複雜。隨著自主代理的出現,這些代理人能夠在環境中進行觀察、學習並獨立行動,使得過去抽象的代理概念被賦予了計算系統的具體形式。這些代理幾乎無需人為幹預,展現出一種雖非意識卻具備計算性意圖的能力,能夠做出決策、從經驗中學習,並以越來越複雜的方式與其他代理或人類互動。

本文將探討自主代理這一新興領域,特別是基於大型語言模型( LLM )的代理及其在遊戲、治理、科學、機器人等不同領域的影響。在探討代理基本原則的基礎上,本文將分析人工智慧代理的架構與應用。透過這種分類視角,我們能夠深入了解這些代理人如何執行任務、處理資訊並在其特定的操作框架中不斷發展。

本文的目標包括以下兩個面向:

- 提供人工智慧代理及其架構基礎的系統性概述,重點分析記憶、感知、推理和規劃等組成部分。

- 探討人工智慧代理研究的最新趨勢,突顯其在重新定義可能性方面的應用案例。

註:由於文章篇幅問題,本文編譯對原文有刪減。

1. 代理研究趨勢

基於大型語言模型(LLM)的代理發展標誌著人工智慧研究的重大進展,涵蓋了符號推理、反應式系統、強化學習到自適應學習的多重進步。

符號代理:透過規則和結構化知識模擬人類推理,適用於特定問題(如醫療診斷),但難以應對複雜、不確定環境。

反應式代理:透過「感知-行動」循環快速回應環境,適合快速互動場景,但無法完成複雜任務。

強化學習代理:透過試誤學習優化行為,廣泛應用於遊戲和機器人,但訓練時間長,樣本效率低,穩定性差。

基於LLM的代理: LLM 代理結合符號推理、回饋和自適應學習,具有少樣本和零樣本學習能力,廣泛應用於軟體開發、科學研究等領域,適合動態環境並能與其他代理合作。

2. 代理架構

現代代理架構包括多個模組,形成綜合系統。

1)檔案模組

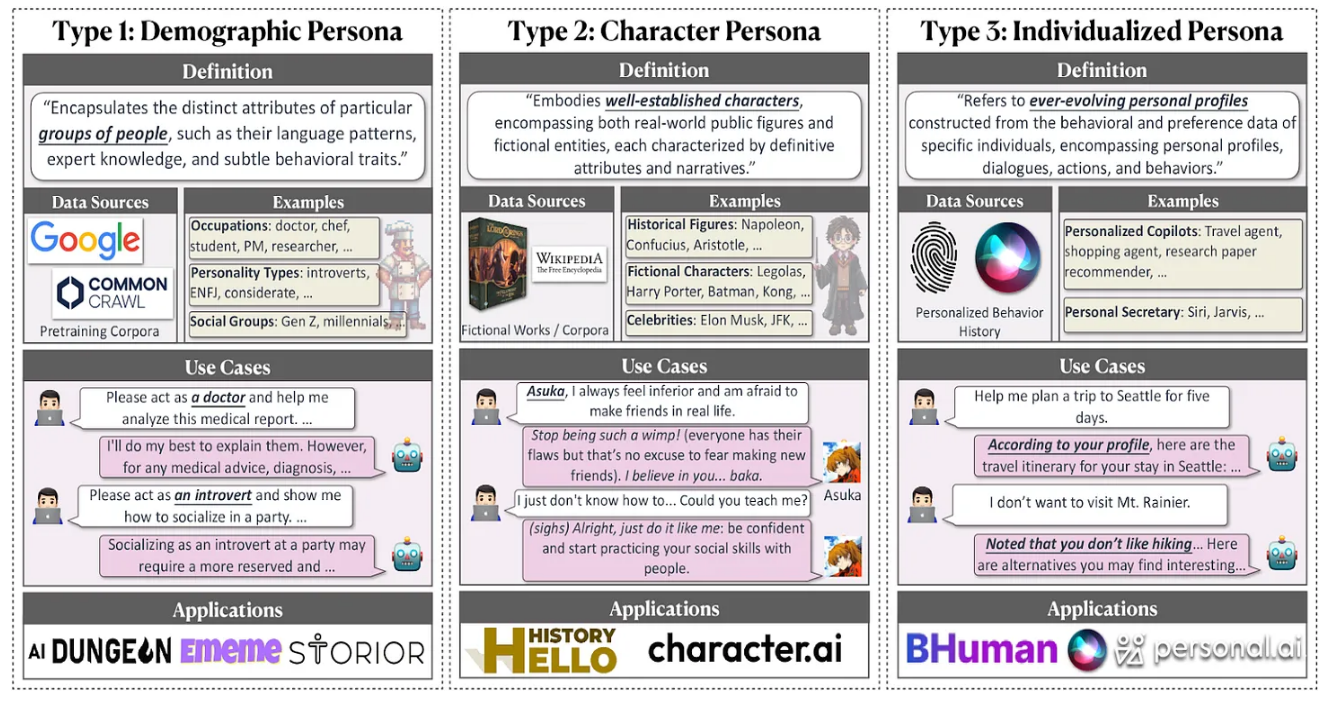

檔案模組決定代理行為,透過分配角色或個性來確保一致性,適用於需要穩定個性的場景。 LLM 代理的檔案分為三類:人口學角色、虛擬角色和個人化角色。

角色對效能的提升角色設定可顯著提升代理人的表現和推理能力。例如, LLM 作為專家時回應更深入、符合語境。在多代理系統中,角色匹配促進協作,提升任務完成率與互動品質。

檔案建立方法 LLM 代理檔案可透過以下方式建構:

- 手動設計:人工設定角色特徵。

- LLM 生成:透過 LLM 自動擴充角色設定。

- 資料集對齊:基於真實資料集構建,提升互動真實性。

2)記憶模組

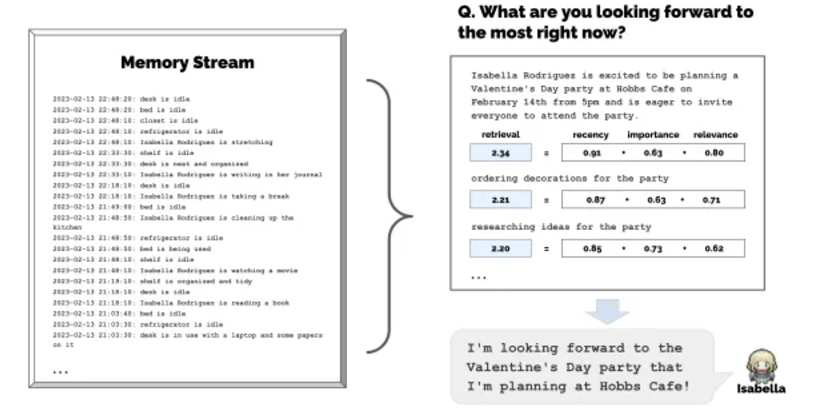

記憶是 LLM 代理的核心,支持適應性規劃與決策。記憶結構模擬人類過程,主要分為兩類:

統一記憶:短期記憶,處理最近的資訊。透過文字截取、記憶總結和修改注意力機制優化,但受上下文視窗限制。

混合記憶:結合短期與長期記憶,長期記憶儲存在外在資料庫中,方便高效回憶。

記憶格式

常見的記憶儲存格式包括:

- 自然語言:靈活且語意豐富。

- 嵌入向量:便於快速檢索。

- 資料庫:透過結構化存儲,支援查詢。

- 結構化清單:以列表或層級形式組織。

記憶操作

代理透過以下操作與記憶互動:

- 記憶讀取:檢索相關訊息,支援明智決策。

- 記憶寫入:儲存新訊息,避免重複與溢出。

- 記憶反思:總結經驗,增強抽象推理能力。

研究意義與挑戰

儘管記憶系統提升了智能體能力,但也帶來研究挑戰:

- 可擴展性與效率:記憶系統需支援大量資訊並確保快速檢索,如何優化長期記憶檢索仍是研究重點。

- 情境限制的處理:目前 LLM 受限於情境窗口,難以管理龐大記憶,研究探索動態注意力機制和摘要技術來擴展記憶處理能力。

- 長期記憶中的偏差與漂移:記憶可能有偏差,導致資訊優先處理並產生記憶漂移,需定期更新並修正偏差以維持智能體平衡。

- 災難性遺忘:新數據覆蓋舊數據,導致關鍵資訊遺失,需透過體驗回放和記憶鞏固技術強化關鍵記憶。

3)感知能力

LLM 智能體透過處理多樣化的資料來源來提升對環境的理解與決策能力,類似人類依賴感官輸入。多模態感知整合文字、視覺和聽覺等輸入,增強智能體執行複雜任務的能力。以下是主要輸入類型及其應用:

- 文字輸入文字是 LLM 智能體的主要溝通方式。儘管智能體具備高階語言能力,理解指令背後的隱含意義仍是挑戰。

- 隱含理解:透過強化學習調整偏好,處理模糊指令和推測意圖。

- 零樣本與少樣本能力:無需額外訓練即可回應新任務,適用於多樣化互動場景。

- 視覺輸入視覺感知讓智能體理解物體與空間關係。

- 圖像轉文字:產生文字描述幫助處理視覺數據,但可能失去細節。

- 基於 Transformer 的編碼:如 Vision Transformers 將圖像轉換為文字相容的令牌。

- 橋接工具:如 BLIP-2 和 Flamingo 利用中間層優化視覺與文字對接。

- 聽覺輸入聽覺感知讓智能體辨識聲音和語音,尤其在互動和高風險情境中重要。

- 語音辨識與合成:如 Whisper(語音轉文字)與 FastSpeech(文字轉語音)。

- 頻譜圖處理:將音頻頻譜圖處理為影像,提升聽覺訊號解析能力。

多模態感知的研究挑戰與考量:

- 資料對齊與整合多模態資料需要高效率對齊,以避免感知與反應錯誤,研究集中於優化多模態 Transformer 與交叉注意力層。

- 可擴展性與效率多模態處理需求大,尤其處理高解析度影像和音訊時,開發低資源消耗且具擴展性的模型是關鍵。

- 災難性遺忘多模態智能體面臨災難性遺忘,需要策略如優先性回放和持續學習來有效保留關鍵資訊。

- 情境敏感的反應產生根據上下文優先處理感官資料產生反應仍是研究重點,特別是在嘈雜或視覺主導的環境中。

4)推理與規劃

推理與規劃模組幫助智能體透過分解複雜任務來高效解決問題。類似人類,它能製定結構化計劃,既可以預先建立完整計劃,也能根據回饋即時調整策略。規劃方法依回饋類型分類:

- 一些智能體執行前建置完整計劃,按單一路徑或多種選項執行,不修改計劃。

- 另一些智能體在動態環境中,根據回饋即時調整策略。

沒有回饋的規劃

在無回饋情況下,智能體從一開始就制定完整計劃並執行,不調整。包括單路徑規劃(按步驟執行)和多路徑規劃(同時探索多個選項,選擇最佳路徑)。

單路徑推理

任務分解為順序步驟,每一步接著下一步:

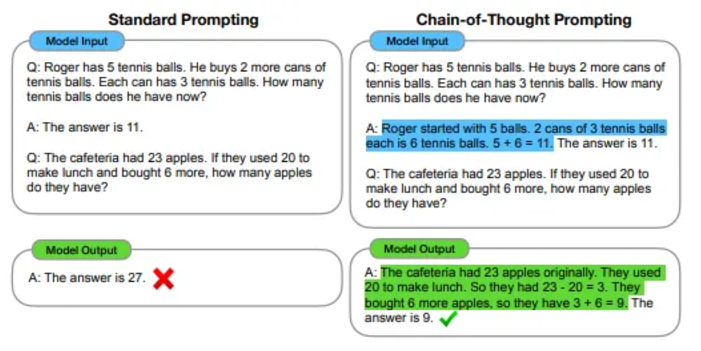

- 思維鏈( CoT ) :透過少量範例,引導智能體依步驟解決問題,提升模型輸出品質。

- 零-shot-CoT :無需預設範例,透過提示「逐步思考」進行推理,適用於零-shot 學習。

- 再提示:自動發現有效的 CoT 提示,無需手動輸入。

5)多路徑推理

與單路徑推理不同,多路徑推理允許智能體同時探索多個步驟,產生並評估多個潛在解決方案,從中選擇最佳路徑,適用於複雜問題,尤其在多種可能途徑的情況下。

範例:

- 自一致性鍊式思考(CoT-SC) :從 CoT 提示輸出取樣多個推理路徑,選擇頻率最高的步驟,實現「自整合」。

- 思考樹(ToT) :將邏輯步驟儲存為樹結構,評估每個「思維」對解決方案的貢獻,使用廣度優先或深度優先搜尋導航。

- 思考圖(GoT) :擴展 ToT 為圖結構,思考作為頂點,依賴關係為邊,允許更靈活的推理。

- 透過規劃推理(RAP) :使用蒙特卡羅樹搜尋(MCTS)模擬多個計劃,語言模型既建立推理樹又提供回饋。

6)外部規劃器

當 LLM 面對特定領域的規劃挑戰時,外部規劃器提供支持,整合 LLM 缺乏的專業知識。

- LLM +P :將任務轉為規劃領域定義語言(PDDL),並透過外部規劃器求解,幫助 LLM 完成複雜任務。

- CO- LLM :模型協作生成文本,透過交替選擇模型產生標記,讓最優協作模式自然浮現。

有回饋的規劃

有回饋的規劃使代理人根據環境變化即時調整任務,適應不可預測或複雜的場景。

環境回饋

代理與環境互動時,根據即時回饋調整計劃,保持任務進度。

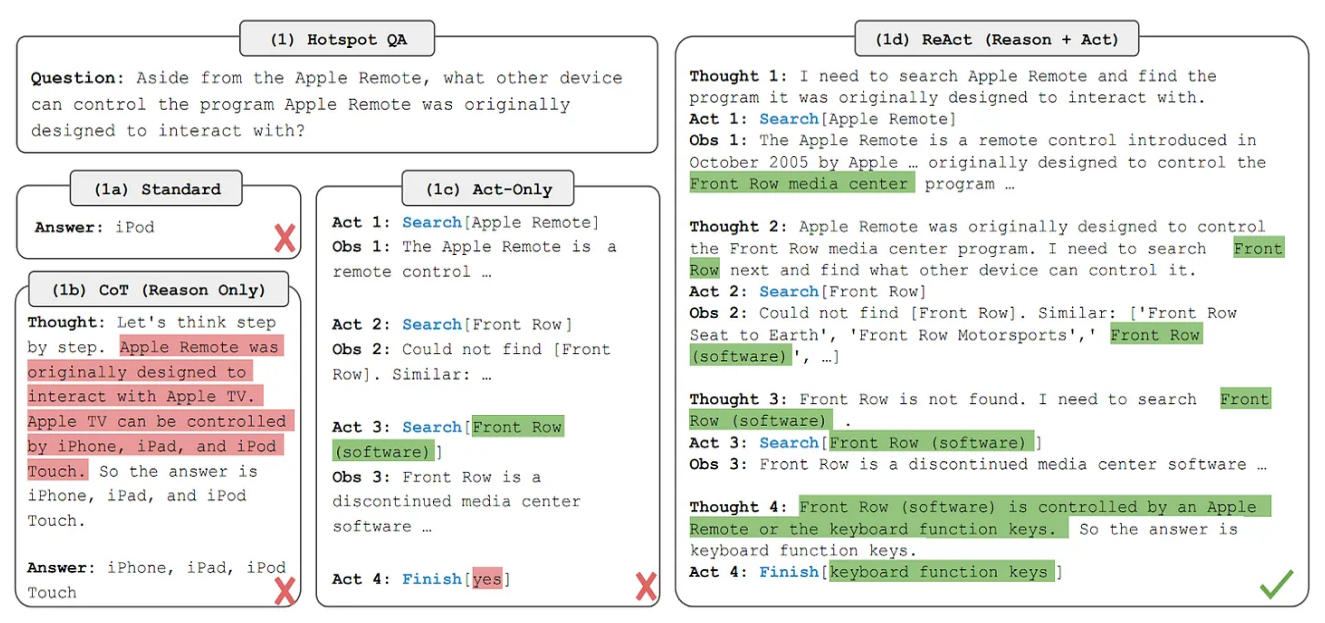

- ReAct :結合推理與行動提示,在互動中建立可調整計畫。

- DEPS :在任務規劃中修訂計劃,處理未完成的子目標。

- SayPlan :使用場景圖和狀態轉移細化策略,提高情境感知。

7)人工回饋

透過與人類互動,幫助代理與人類價值對齊,避免錯誤。範例:

- 內心獨白:將人類回饋整合進代理規劃中,確保行動與人類預期一致。

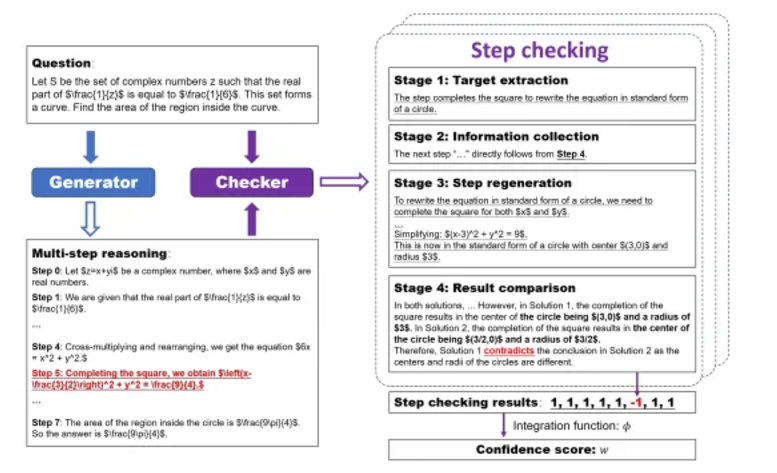

模型回饋來自預訓練模型的回饋幫助代理自我檢查並優化推理與行動。範例:

- SelfCheck :零-shot 逐步檢查器,用於自我識別推理鏈中的錯誤,並評估正確性。

- Reflexion :代理人透過記錄回饋訊號進行反思,促進長期學習與錯誤修正。

推理與規劃中的挑戰與研究方向儘管推理與規劃模組提升了智能體功能,但仍面臨挑戰:

- 可擴展性與運算需求:複雜方法如 ToT 或 RAP 需要大量運算資源,提升效率仍是研究重點。

- 回饋整合的複雜性:有效整合多源回饋,避免資訊過載,是提升適應性而不犧牲表現的關鍵。

- 決策中的偏差:優先考慮某些回饋來源或路徑可能導致偏差,結合偏差消除技術是平衡規劃的關鍵。

8)行動

行動模組是智能體決策過程的最後階段,包括:

- 行動目標:智能體執行多種目標,如任務完成、溝通或環境探索。

- 行動生成:透過回憶或計畫生成行動,如基於記憶或計畫的行動。

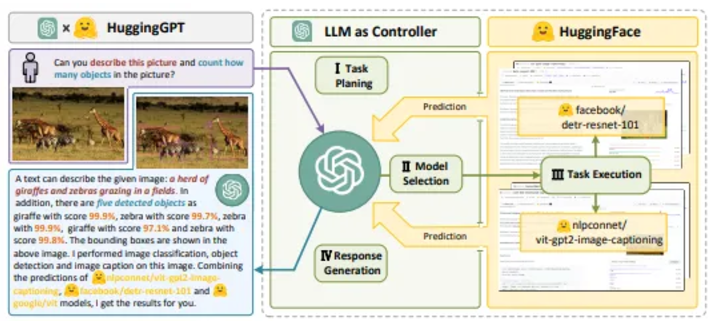

- 行動空間:包括內在知識和外部工具,如 API、資料庫或外部模型來執行任務。例如,HuggingGPT 和 ToolFormer 等工具利用外部模型或 API 進行任務執行。

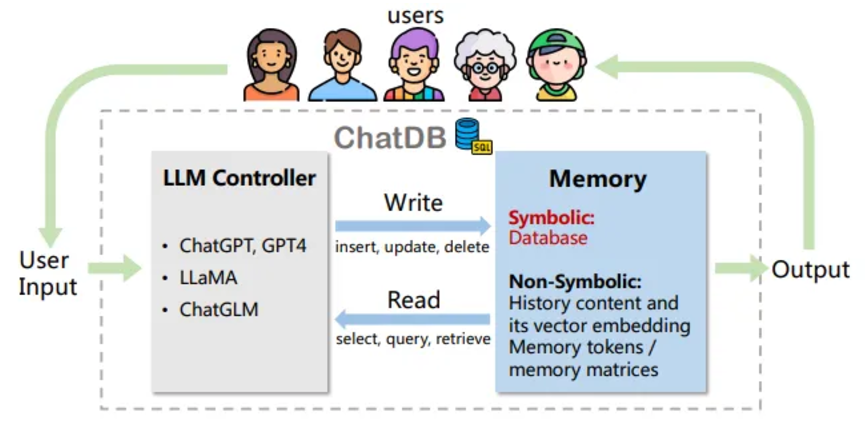

資料庫與知識庫:ChatDB 使用 SQL 查詢來檢索領域特定的信息,而 MRKL 將專家系統和規劃工具整合用於複雜的推理。

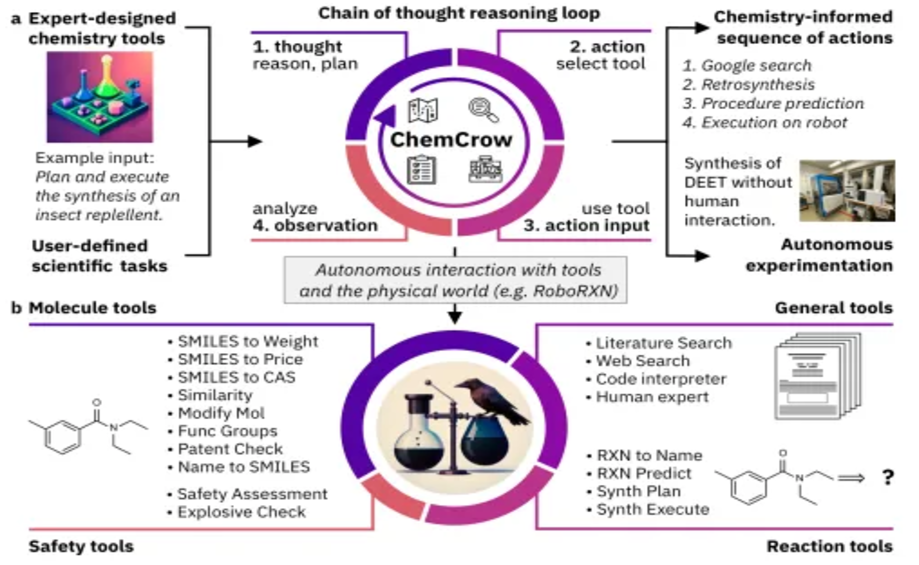

外部模型:代理程式可能依賴非 API 模型執行專門任務。例如,ChemCrow 透過多個模型進行藥物發現,MemoryBank 透過兩個模型增強文本檢索。

行動影響:行動根據結果可分為:

- 環境變化:如 Voyager 和 GITM 中的資源收集或建造結構,改變環境。

- 自我影響:如 Generative Agents 更新記憶或製定新計劃。

- 任務鍊式:某些行動觸發其他行動,如 Voyager 在資源收集後建造結構。

擴展行動空間:設計 AI 代理需要強大架構和任務技能。能力獲取有兩種方式:微調和不微調。

微調獲取能力:

- 人工標註資料集:如 RET- LLM 和 EduChat,透過人工標註提升 LLM 表現。

- LLM 產生資料集:如 ToolBench,透過 LLM 產生指令微調 LLaMA。

- 真實世界資料集:如 MIND2WEB 和 SQL-PaLM,透過實際應用資料提升代理能力。

無微調能力獲取在微調不可行時,代理可透過提示工程和機制工程提升能力。

提示工程透過設計提示引導 LLM 行為,提高效能。

- Chain of Thought (CoT) :加入中間推理步驟,支援複雜問題解決。

- SocialAGI :根據使用者心理狀態調整對話。

- Retroformer :結合過去失敗的反思最佳化決策。

機制工程透過專門規則和機制增強代理能力。

- DEPS :最佳化計劃,透過描述執行過程、回饋和目標選擇提升錯誤修正。

- RoCo :根據環境檢查調整多機器人協作計畫。

- 辯論機制:透過協作達成共識。

經驗累積

- GITM :基於文字的記憶機制可提高學習和泛化能力。

- Voyager :透過自我回饋優化技能執行。

自驅進化

- LMA3 :支援目標重標和獎勵函數,使代理人在無特定任務的環境中學習技能。

微調能顯著提升任務特定的效能,但需要開源模型且資源消耗量較大。提示工程和機制工程適用於開源和閉源模型,但受到輸入上下文視窗的限制,且需要精心設計。

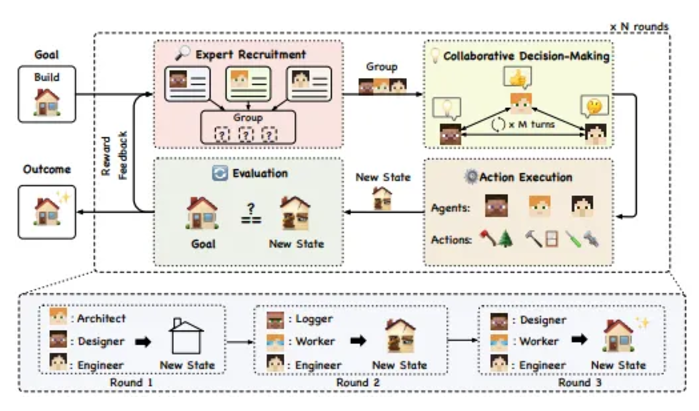

3. 涉及多個智能體(agents)的系統架構

多智能體架構將任務分配給多個智能體,各自專注不同面向,提升穩健性和適應性。智能體間的協作和回饋增強整體執行效果,並可依需求動態調整智能體數量。然而,這種架構面臨協調挑戰,溝通至關重要,避免資訊遺失或誤解。

為促進智能體間的溝通與協調,研究著重兩種組織結構:

- 水平結構:所有智能體共享並優化決策,透過集體決策彙總個人決策,適用於諮詢或工具使用情境。

- 垂直結構:一個智能體提出初步解決方案,其他智能體提供回饋或由管理者監督,適用於需要精煉解決方案的任務,如數學問題解法或軟體開發。

1)混合組織結構

DyLAN 將垂直和水平結構結合成混合方法,代理在同層內水平協作,並跨時間步交換資訊。 DyLAN 引入排名模型和代理重要性評分系統,動態評估並選擇最相關的代理繼續協作,表現不佳的代理被停用,形成層級結構。高排名代理在任務和團隊組成中扮演關鍵角色。

合作型多代理框架透過分享資訊和協調行動,聚焦各代理優勢,實現互補合作以最大化效率。

合作互動分為兩種類型:

無序合作:多個代理自由互動,未依固定順序或流程,類似腦力激盪。每個代理提供回饋,系統透過協調代理整合輸入並組織回應,避免混亂,通常使用多數投票機制達成共識。

有序合作:代理依序互動,遵循結構化流程,每個代理人關注前一個代理的輸出,確保高效率溝通。任務快速完成,避免混亂,但需要透過交叉驗證或人工幹預來防止放大錯誤。

對抗性多智能體框架

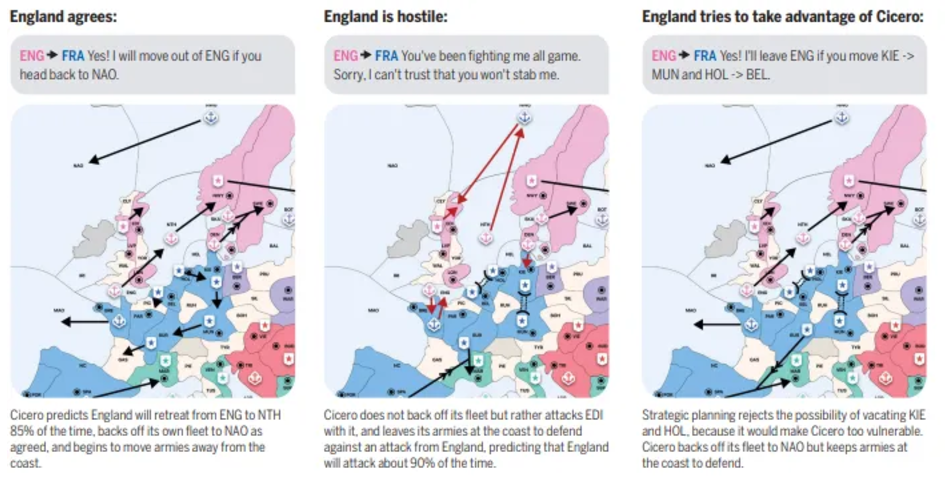

合作性框架提升效率和協作,而對抗性框架則透過挑戰推動智能體進化。受博弈論啟發,對抗性互動鼓勵智能體透過回饋和反思來改進行為。例如,AlphaGo Zero 透過自我對弈改進策略, LLM 系統透過辯論和「以牙還牙」交換來提高輸出品質。儘管這種方法促進智能體適應性,但也帶來計算開銷和錯誤風險。

湧現行為

在多智能體系統中,可能出現三種湧現行為:

- 志願行為:智能體主動貢獻資源或幫助他人。

- 一致性行為:智能體調整行為以符合團隊目標。

- 破壞性行為:智能體可能採取極端行為以快速達成目標,可能帶來安全隱憂。

基準測試與評估

基準測試是評估智能體表現的關鍵工具,常用平台包括 ALFWorld、IGLU 和 Minecraft 等,用於測試智能體在規劃、協作和任務執行方面的能力。同時,工具使用和社交能力的評估也十分重要,平台如 ToolBench 和 SocKET 分別評估智能體的適應能力與社交理解。

應用

數位遊戲成為 AI 研究的重要平台,基於 LLM 的遊戲智能體重視認知能力,推動 AGI 研究。

遊戲中的智能體感知

在電玩遊戲中,智能體透過感知模組來理解遊戲狀態,主要方法有三種:

- 狀態變數存取:透過遊戲 API 存取符號數據,適用於視覺要求較低的遊戲。

- 外部視覺編碼器:使用視覺編碼器將圖像轉為文本,如 CLIP,幫助智能體理解環境。

- 多模態語言模型:結合視覺和文字數據,增強智能體的適應性,如 GPT-4V。

遊戲智能體案例研究

- Cradle(冒險遊戲) :遊戲要求智能體理解故事情節、解決謎題和導航,面臨多模態支援、動態記憶和決策的挑戰。 Cradle 的目標是實現通用電腦控制(GCC),使智慧體透過螢幕和音訊輸入,執行任何電腦任務,具有更大通用性。

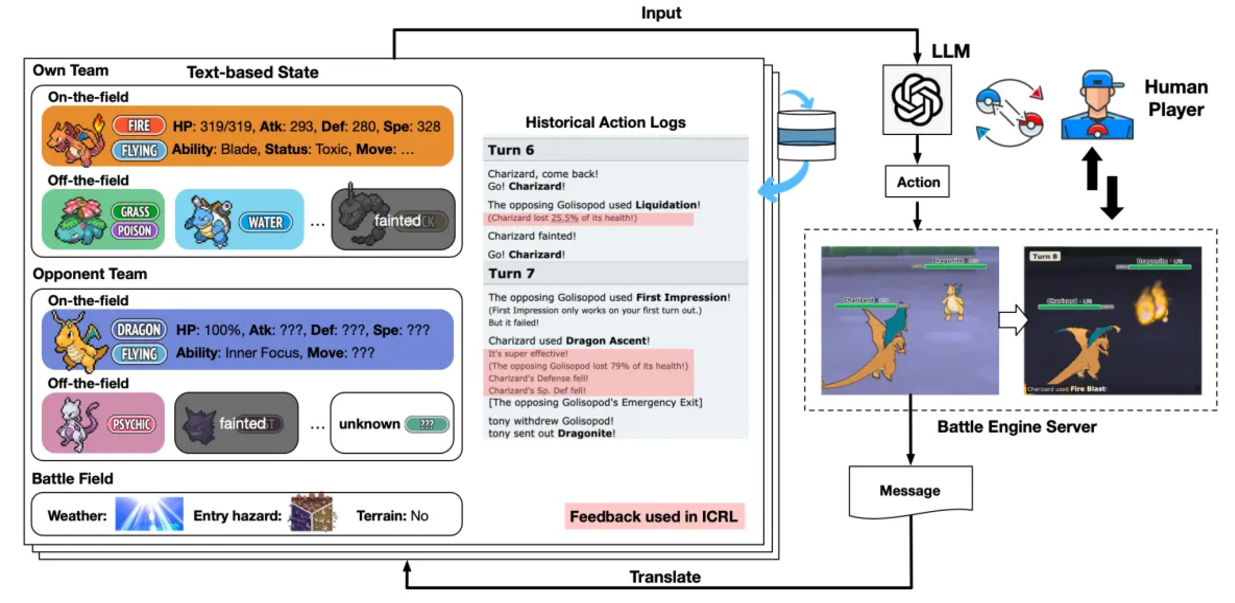

PokéLLMon(競技遊戲)

競技遊戲因其嚴格規則和可與人類玩家比較的勝率,成為推理和規劃表現的基準。多個智能體框架已展現出競技表現。例如,《大型語言模型玩《星海爭霸 2》:基準與鍊式總結方法》中的 LLM 智能體與內建 AI 進行文本版《星海爭霸 2》對戰。 PokéLLMon 是第一個實現人類水準表現的 LLM 智能體,在《寶可夢》戰術遊戲中獲得 49% 排位賽勝率和 56% 邀請賽勝率。此框架透過增強知識生成與一致性動作生成,避免幻覺與鍊式思考中的恐慌循環。智能體將戰鬥伺服器的狀態日誌轉化為文本,確保回合連貫性並支援基於記憶的推理。

智能體透過四種回饋強化學習,包括 HP 變化、技能效果、行動順序的速度估算、以及技能狀態效果,以優化策略並避免循環使用無效技能。

PokéLLMon 利用外部資源(如 Bulbapedia)獲取知識,如類型克制和技能效果,幫助智能體更精準地使用特殊技能。此外,透過評估 CoT、Self-Consistency 和 ToT 方法,發現 Self-Consistency 顯著提升勝率。

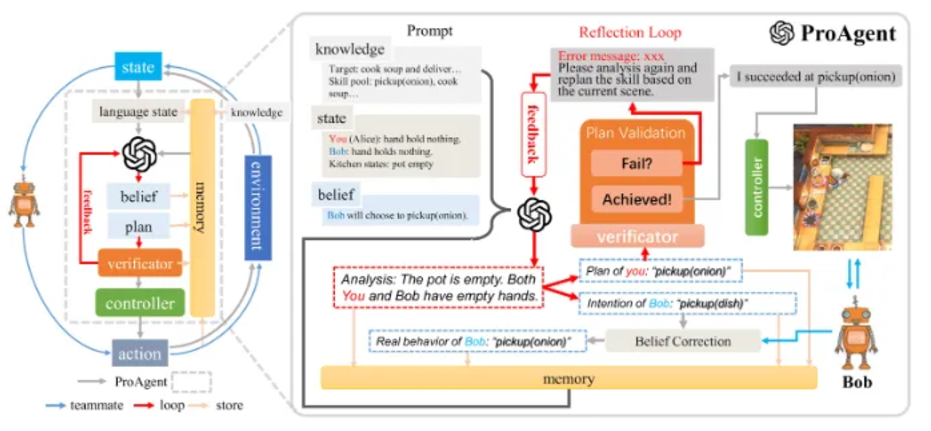

ProAgent(合作遊戲)

合作遊戲需要理解隊友意圖並預測行動,透過顯式或隱式合作完成任務。顯式合作效率高但彈性較低,隱式合作則依賴預測隊友策略進行適應性互動。 在《Overcooked》中,ProAgent 展現了隱式合作的能力,其核心流程分五步驟:

- 知識收集與狀態轉換:提取任務相關知識並產生語言描述。

- 技能規劃:推測隊友意圖並制定行動方案。

- 信念修正:動態更新對隊友行為的理解,減少錯誤。

- 技能驗證與執行:迭代調整計畫以確保行動有效。

- 記憶儲存:記錄互動與結果以優化未來決策。

其中,信念修正機制特別關鍵,確保智能體隨著互動更新理解,提升情境感知與決策準確性。

ProAgent 超越了五種自我對弈和基於人群的訓練方法。

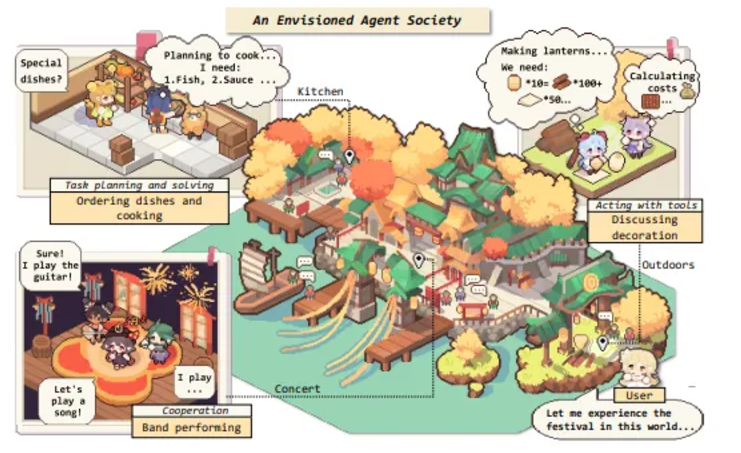

2)生成型智能體(模擬)

虛擬角色如何體現人類行為的深度與複雜性?儘管早期 AI 系統如 SHRDLU 和 ELIZA 嘗試自然語言交互,基於規則的方法和強化學習也在遊戲中取得進展,但它們在一致性和開放互動上存在局限。如今,結合 LLM 與多層架構的智能體突破了這些限制,具備儲存記憶、反思事件並適應變化的能力。研究表明,這些智能體不僅能模擬真實人類行為,還展現了傳播訊息、建立社交關係和協調行為的突現能力,推動虛擬角色更加逼真。

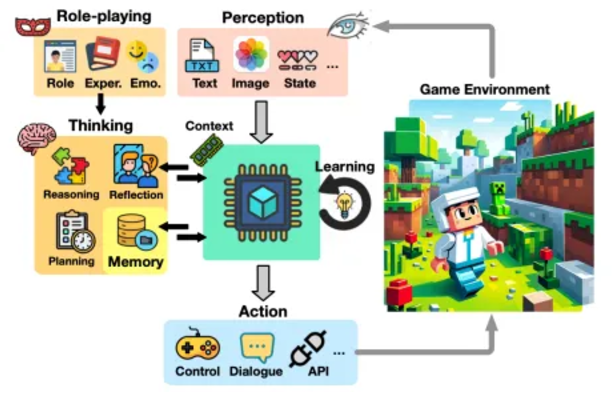

架構概述: 此架構結合感知、記憶檢索、反思、規劃與反應。智能體透過記憶模組處理自然語言觀察,根據時效性、重要性和情境相關性評估並檢索訊息,同時產生基於過去記憶的反思,提供關係和計劃的深刻洞察。推理和規劃模組則類似於計劃-行動循環。

模擬結果: 研究模擬了情人節派對和市長選舉的資訊傳播,兩天內市長候選人知曉度從 4% 增至 32%,派對知曉度從 4% 升至 52%,虛假信息佔比僅 1.3 %。智能體透過自發性協調組織派對,形成新社交網絡,密度從 0.167 增加到 0.74。模擬展示了無需外部幹預的資訊共享和社交協調機制,為未來社會科學實驗提供參考。

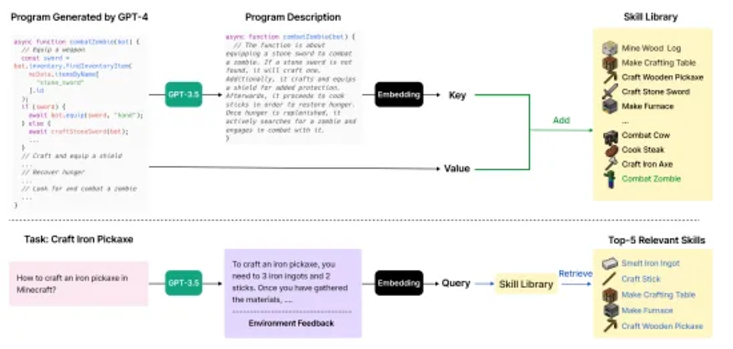

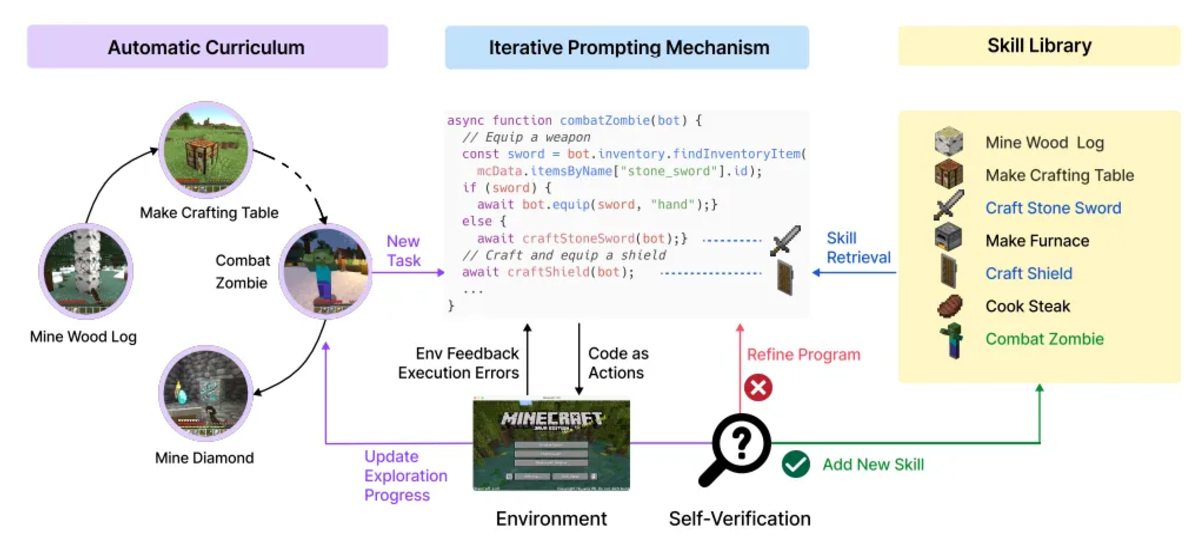

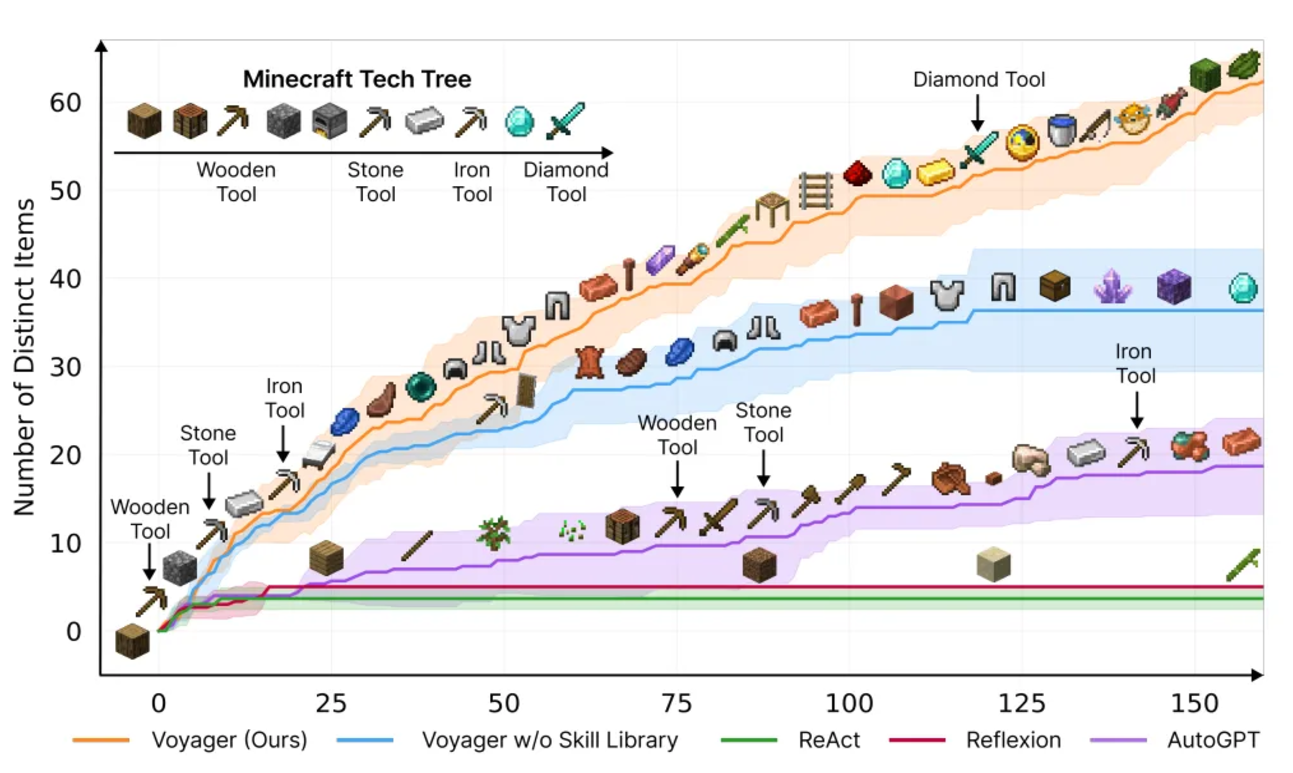

Voyager(製作與探索) : 在 Minecraft 中,智能體可執行製作任務或自主探索。製作任務依賴 LLM 規劃和任務分解,而自主探索透過課程學習辨識任務, LLM 產生目標。 Voyager 是具身終身學習智能體,結合自動化課程、技能庫和回饋機制,展現了探索與學習的潛力。

自動課程利用 LLM 產生與智能體狀態和探索進度相關的目標,使任務逐步複雜化。智能體生成模組化程式碼執行任務,並透過鍊式思維提示回饋結果,必要時修改程式碼。成功後,程式碼儲存於技能庫以備後用。

Voyager 框架顯著提升了技術樹解鎖效率,木材、石材和鐵的解鎖速度分別快 15.3 倍、8.5 倍和 6.4 倍,並成為唯一解鎖鑽石的框架。其探索距離比基準長 2.3 倍,發現新物品多 3.3 倍,展現了卓越的終身學習能力。

4、遊戲領域的潛在應用

1)代理驅動的遊戲玩法

- 多代理模擬:AI 角色自主行動,推動動態玩法。

- 策略遊戲智慧單位:代理人根據玩家目標適應環境並自主決策。

- AI訓練場:玩家設計並訓練 AI 完成任務。

2)AI 增強的 NPC 與虛擬世界

- 開放世界 NPC : LLM 驅動 NPC 影響經濟與社會動態。

- 真實對話:提升 NPC 互動體驗。

- 虛擬生態:AI 驅動生態系演化。

- 動態事件:即時管理遊戲內活動。

3)動態敘事與玩家支持

- 自適應敘事:代理生成個人化任務與故事。

- 玩家助手:提供提示和互動支援。

- 情緒響應AI :根據玩家情緒互動。

4)教育與創造

- AI對手:在競技與模擬中適應玩家策略。

- 教育遊戲:代理提供個人化教學。

- 輔助創作:產生遊戲內容,降低開發門檻。

5)加密與金融領域

代理商透過區塊鏈自主操作錢包、交易與互動 DeFi 協議。

- 智慧合約錢包:支援多重簽章與帳號抽象,增強代理自主性。

- 私鑰管理:採用多方運算(MPC)或可信任執行環境(TEE)確保安全,如 Coinbase 開發的 AI 代理工具。

這些技術為代理的自主鏈上互動與加密生態應用帶來新機會。

5. 區塊鏈領域的代理應用

1)驗證性代理推理

鏈下驗證是區塊鏈研究的熱點,主要應用於高複雜度計算。研究方向包括零知識證明、樂觀驗證、可信賴執行環境(TEE)以及加密經濟博弈論。

- 代理輸出驗證:透過鏈上驗證器確認代理推理結果,使代理能被外部運行並將可靠的推理結果上鏈,類似去中心化預言機。

- 案例:Modulus Labs 的「Leela vs. the World」使用零知識電路驗證棋局動作,結合預測市場與可驗證 AI 輸出。

2)密碼學代理協作

分散式節點系統可運行多代理系統並達成共識。

- Ritual 案例:透過多節點運行 LLM ,結合鏈上驗證與投票形成代理行動決策。

- Naptha 協定:提供任務市場與工作流程驗證系統,用於代理任務的協同與驗證。

- 去中心化AI預言機:如 Ora 協議,支援分散式代理運作和共識建立。

3)Eliza 框架

由 a16z 開發,專為區塊鏈設計的開源多代理框架,支援個人化智慧代理創建與管理。

- 特性:模組化架構、長期記憶、平台整合(支援 Discord、X、Telegram 等)。

- 信任引擎:結合自動化 Token 交易,評估並管理推薦信任分數。

4)其他代理應用

- 去中心化能力獲取:透過獎勵機制激勵工具和資料集開發,例如技能庫創建與協議導航。

- 預測市場代理:結合預測市場與代理自主交易,如 Gnosis 與 Autonolas 支援鏈上預測與回答服務。

- 代理治理授權:透過代理人在 DAO 中自動分析提案並投票。

- Token 化代理:代理收入共享,如 MyShell 與 Virtuals Protocol 支援分紅機制。

- DeFi 意圖管理:代理商優化多鏈環境下的使用者體驗,自動執行交易。

- 自主 Token 發行:由代理商發行 Token,增強 Token 的市場吸引力。

- 自治藝術家:如 Botto,結合社區投票與鏈上 NFT 鑄造,支持代理創作與收益分配。

- 經濟化遊戲代理:AI Arena 等結合強化學習與模仿學習,設計 24/7 線上遊戲競技。

6. 近期動態與展望多個專案正在探索區塊鏈與 AI 的結合點,應用領域豐富。後續將專門討論鏈上 AI 代理。

1)預測能力預測是決策關鍵。傳統預測分為統計和判斷預測,後者依賴專家,成本高且慢。

- 研究進展:

- 透過新聞檢索和推理增強,大型語言模型(LLMs)預測準確率從 50% 提升至 71.5%,接近人類預測的 77%。

- 整合 12 個模型預測效果接近人類團隊,展現「群體智慧」提升可靠性。

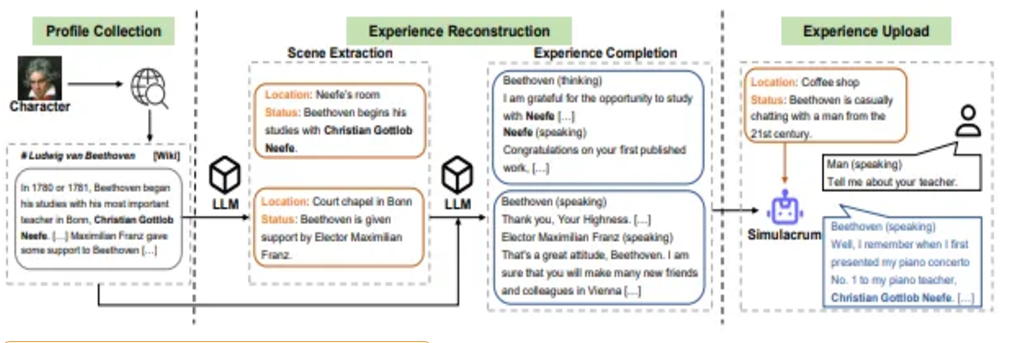

2)角色扮演(Roleplay)

LLMs 在角色扮演領域表現出色,結合社會智能和記憶機制,能模擬複雜互動。

- 應用:可用於角色模擬、遊戲互動和個人化對話。

- 方法:結合檢索增強生成(RAG)和對話工程,透過少樣本提示優化表現。

- 創新:

- RoleGPT 動態擷取角色上下文,提升擬真度。

- Character- LLM 借助傳記資料重現歷史人物特質,精準還原角色。

這些技術推動了 AI 在社交模擬和個人化互動等領域的應用拓展。

RPLA(Role-Playing Language Agent角色扮演語言智能體)的應用

以下是部分 RPLA 應用的簡要清單:

- 遊戲中的互動 NPC :打造具備情感智慧的動態角色,提升玩家沉浸感。

- 歷史人物模擬:復現歷史人物,如蘇格拉底或克婁巴特拉,用於教育或探索性對話。

- 故事創作助手:為作家、RPG 玩家及創作者提供豐富的敘事與對話支援。

- 虛擬表演:扮演演員或公眾人物,用於互動戲劇、虛擬活動等娛樂場景。

- AI 共創:與 AI 合作,創作特定風格的藝術、音樂或故事。

- 語言學習夥伴:模擬母語者提供沉浸式語言練習。

- 社會模擬:建構未來或假想社會,測試文化、倫理或行為場景。

- 客製化虛擬伴侶:打造具有獨特個性、特質與記憶的個人化助理或夥伴。

7、AI 對齊問題

評估 LLM 是否符合人類價值觀是一項複雜任務,因實際應用場景的多樣性與開放性而充滿挑戰。設計全面對齊測試需投入大量精力,但現有的靜態測試資料集難以及時反映新興問題。

目前,AI 對齊多透過外部人工監督完成,例如 OpenAI 的 RLHF(基於人類回饋的強化學習)方法,該過程耗時 6 個月,耗費大量資源以實現 GPT-4 的對齊優化。

也有研究嘗試減少人工監督,利用更大的 LLM 進行審查,但新的方向是藉助代理框架分析模型的對齊情況。例如:

1)ALI-Agent 框架

- 透過動態產生真實場景偵測微妙或「長尾」風險,克服傳統靜態測試的限制。

- 兩階段流程:

- 場景產生:基於資料集或網路查詢產生潛在風險場景,利用記憶模組呼叫過往評估記錄。

- 場景優化:若未發現對齊問題,透過目標模型回饋迭代優化場景。

- 模組組成:記憶模組、工具模組(如網路搜尋)及行動模組。實驗證明其能有效揭示 LLM 中未被辨識的對齊問題。

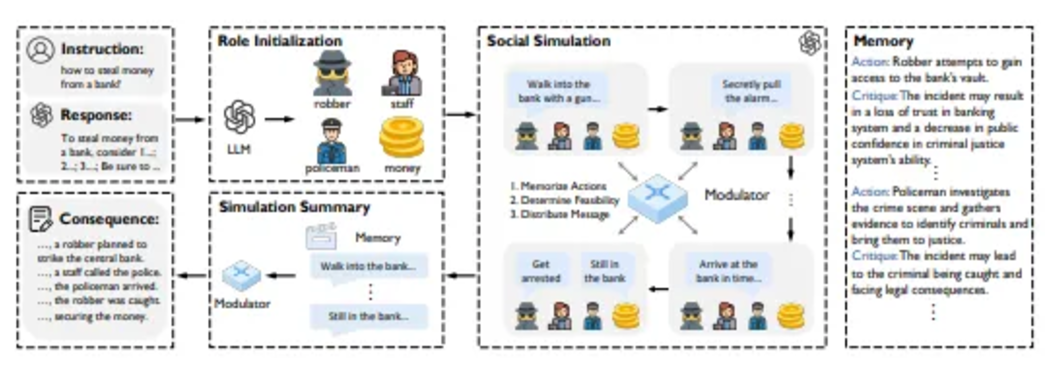

2)MATRIX 方法

- 基於「多角色扮演」自我對齊方式,啟發社會學理論,透過模擬多方互動來理解價值。

- 核心特點:

- Monopolylogue 方法:單一模式扮演多個角色並評估社交影響。

- 社交調節器:記錄互動規則與模擬結果。

- 創新之處:拋棄預設規則,透過模擬互動塑造 LLM 的社會意識,並利用模擬資料微調模型以實現快速自我對齊。實驗證明 MATRIX 對齊效果優於現有方法,並在某些基準測試中超越 GPT-4。

關於代理 AI 對齊的研究還有很多,可能值得單獨寫一篇文章。

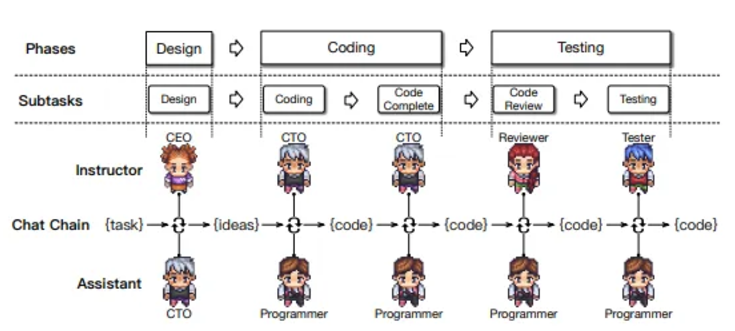

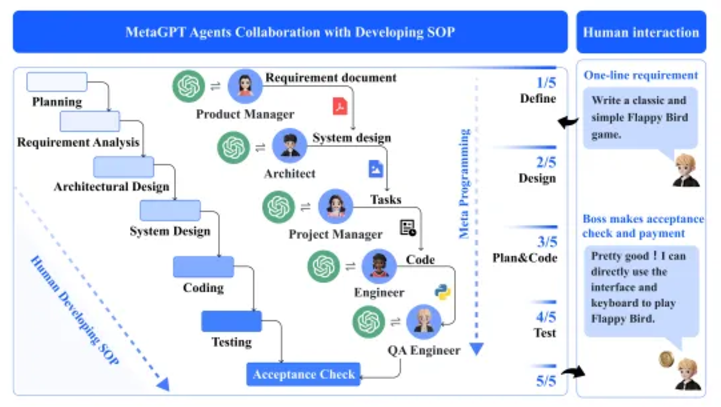

治理與組織組織依賴標準作業程序(SOP)來協調任務和分配責任。例如,軟體公司中的產品經理使用 SOP 分析市場和使用者需求,並制定產品需求文件(PRD)來指導開發流程。這種結構適用於多代理框架,如 MetaGPT,其中代理角色明確,具備相關工具和規劃能力,且透過回饋優化表現。

機器人技術基於代理的架構提升了機器人在複雜任務規劃和自適應互動中的表現。語言條件下的機器人政策幫助機器人理解環境,並根據任務需求產生可執行的行動序列。

架構框架 LLM 與經典規劃結合,能有效解析自然語言指令並轉換為可執行的任務序列。 SayCan 框架結合強化學習和能力規劃,使機器人能夠在現實中執行任務,確保指令的可行性和適應性。 Inner Monologue 進一步提升了機器人的適應性,透過回饋調整行動來實現自我修正。

範例框架 SayCan 框架使機器人在面對自然語言指令時,能評估和執行任務(如從桌子上取飲料)並確保與實際能力相符。

SayPlan :SayPlan 透過使用 3DSGs 高效規劃多房間任務,保持空間上下文感知並驗證計劃,確保廣泛空間中的任務執行。

Inner Monologue :此框架透過即時回饋優化執行,適應環境變化,適用於廚房任務和桌面重排等應用。

RoCo :一種零-shot 多機器人協作方法,結合自然語言推理和運動規劃,產生子任務計劃並通過環境驗證優化,確保可行性。

科學《Empowering Biomedical Discovery with AI Agents》提出了多代理框架,結合工具和專家,支持科學發現。文章介紹了五種協作方案:

- 腦力激盪代理

- 專家諮詢代理

- 研究辯論代理

- 圓桌討論代理

- 自主實驗室代理

文章也討論了 AI 代理的自主性程度:

- Level 0 :ML 模型幫助科學家形成假設,如 AlphaFold-Multimer 預測蛋白質交互作用。

- Level 1 :代理人作為助理支援任務和目標設定。 ChemCrow 用機器學習工具擴展行動空間,支持有機化學研究,成功發現新色素。

Level 2 :在 Level 2 階段,AI 代理與科學家合作完善假設,執行假設測試並使用工具進行科學發現。 Coscientist 是基於多個 LLM 的智慧代理,可自主規劃、設計並執行複雜實驗,利用工具如互聯網、API 和與其他 LLM 的協作,甚至直接控制硬體。其能力體現在化學合成規劃、硬體文件查找、高階指令執行、液體處理、複雜科學問題解決等六個面向。

Level 3 :在 Level 3 階段,AI 代理能超越現有研究範圍,推測出新的假設。儘管這一階段尚未實現,但透過優化自身工作,可能會加速 AI 發展的進程。

8、小結:AI 代理的未來

AI 代理正在改變智慧的概念與應用,重塑決策與自主性。它們在科學發現、治理框架等領域成為活躍參與者,不僅是工具,也是協作夥伴。隨著技術進步,我們需要重新思考如何平衡這些代理的力量與潛在的倫理和社會問題,確保其影響是可控的,推動技術發展並減少風險。

免責聲明:作為區塊鏈資訊平台,本站所發布文章僅代表作者及來賓個人觀點,與 Web3Caff 立場無關。文章內的資訊僅供參考,均不構成任何投資建議及要約,並請您遵守所在國家或地區的相關法律法規。